Petit lexique pour suivre cet article

L'IA générative repose sur une chaîne industrielle qui mobilise des termes peu familiers en dehors du secteur. Voici l'essentiel pour suivre la suite. Si vous êtes familier passez rapidement.

Les puces et leur fabrication

Tout part d'un wafer, un disque de silicium d'environ 30 cm sur lequel on grave des centaines de petites puces appelées dies. Une fois découpées et conditionnées, ces dies deviennent les processeurs que l'on retrouve dans les serveurs. Plus la gravure est fine, plus on peut faire tenir de transistors sur une puce, donc plus elle est puissante et économe. C'est ce qu'on appelle le nœud de gravure : "3 nm", "N2" (2 nm), "A14" (1,4 nm) désignent des générations successives, chacune plus difficile à produire que la précédente. TSMC, à Taïwan, est aujourd'hui quasi seul à produire en volume aux nœuds les plus avancés — d'où sa position critique.

Plusieurs types de puces coexistent :

- GPU (Graphics Processing Unit) : conçu à l'origine pour les jeux vidéo, c'est devenu la puce de référence pour l'IA car il exécute des milliers de calculs en parallèle. NVIDIA domine ce marché (séries H100, Blackwell, Vera Rubin).

- TPU (Tensor Processing Unit) : équivalent maison de Google, optimisé pour les réseaux de neurones.

- ASIC et XPU : puces sur mesure conçues pour une tâche précise, souvent l'inférence (voir plus bas). Broadcom est le grand acteur de ce segment.

- HBM (High Bandwidth Memory) : mémoire empilée en couches au-dessus du processeur, indispensable pour nourrir les GPU à très haute vitesse. SK Hynix, Samsung et Micron se partagent ce marché. La génération HBM4, déployée à partir de mi-2026, est aussi critique que les GPU eux-mêmes.

Les acteurs de l'infrastructure

Les puces vivent dans des data centers, immenses bâtiments climatisés remplis de serveurs. Leur taille se mesure désormais en gigawatts (GW) de puissance électrique : 1 GW correspond grossièrement à la production d'une grosse centrale nucléaire.

Trois familles d'acteurs :

- Les hyperscalers — Amazon (AWS), Microsoft (Azure), Google Cloud, plus Oracle et Meta — opèrent des clouds à très grande échelle.

- Les neoclouds (CoreWeave, Nebius, Crusoe…) sont de nouveaux entrants spécialisés dans la location de calcul IA quand les hyperscalers sont saturés.

- Les laboratoires de modèles (OpenAI, Anthropic, xAI, Mistral…) construisent les modèles et les vendent via des abonnements grand public ou via une API, un canal par lequel d'autres logiciels appellent le modèle.

Comment fonctionne l'IA, en deux temps

L'entraînement consiste à faire ingérer au modèle des quantités massives de texte ou d'images : c'est l'étape la plus coûteuse en calcul, mais elle ne se fait que ponctuellement. L'inférence est l'utilisation du modèle ensuite, lorsqu'un utilisateur lui pose une question : c'est moins coûteux par requête, mais cumulé sur des centaines de millions d'utilisateurs, cela devient le principal poste de coût.

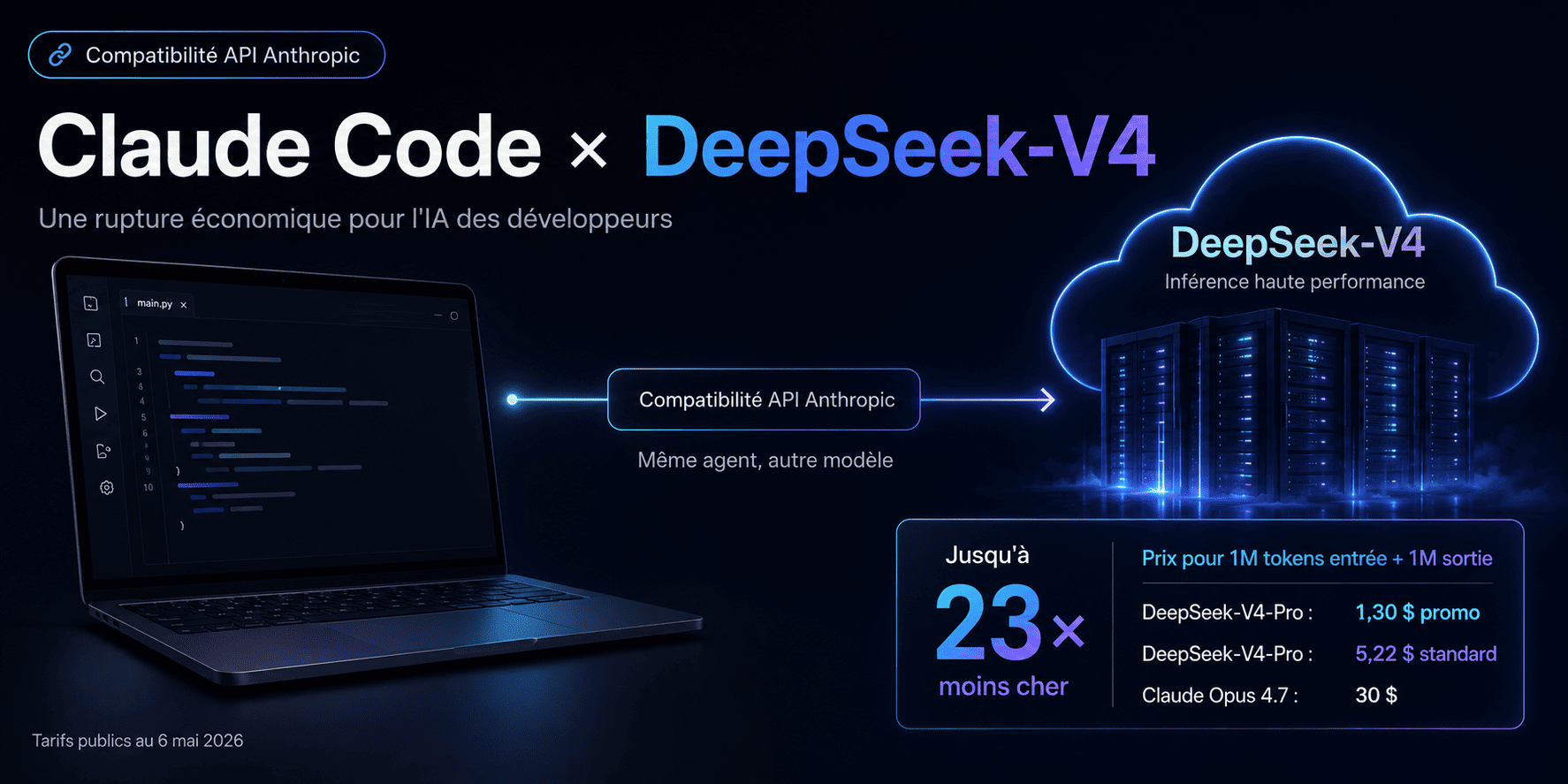

Le token est l'unité de facturation : un mot vaut environ 1,3 token. Le prix par token baisse continûment depuis 2023, ce qui comprime les marges des laboratoires. Les modèles frontière désignent les modèles les plus avancés à un instant donné. Les modèles open weights (Llama, Qwen, DeepSeek) sont ceux dont les paramètres sont librement téléchargeables.

Le vocabulaire financier

- Capex : dépenses d'investissement (data centers, GPU). Opex : dépenses courantes, dont l'électricité.

- Free cash flow : trésorerie disponible une fois le capex payé. Il chute chez Amazon en 2026 parce que le capex IA dépasse la croissance des revenus.

- Backlog / RPO (Remaining Performance Obligations) : contrats signés mais pas encore facturés ; donne une visibilité sur les revenus futurs.

- Run-rate : revenus annualisés à partir des derniers mois (« 30 Md$ de run-rate » = au rythme actuel, 30 Md$ par an).

- Warrant : option permettant d'acheter des actions à un prix fixé à l'avance, conditionnée à des objectifs (volume livré, cours de bourse).

- Investment grade : seuil minimal de solidité financière exigé par les investisseurs obligataires prudents.

Le vocabulaire énergétique

- MW, GW, TWh : 1 GW = 1 000 MW. 1 TWh est l'énergie consommée si on tire 1 GW pendant environ 41 jours.

- Behind-the-meter : électricité produite directement sur le site du data center, sans passer par le réseau public — souvent au gaz, parfois via des SMR (Small Modular Reactors, petits réacteurs nucléaires modulaires).

- PPA (Power Purchase Agreement) : contrat d'achat d'électricité à long terme avec un producteur, devenu un actif stratégique pour les hyperscalers.

Introduction

L'intelligence artificielle générative n'est plus un marché logiciel. En 2026, elle ressemble à une industrie lourde : elle consomme des GPU, des TPU, de la mémoire HBM, des fibres optiques, des transformateurs, du foncier, de l'eau, du gaz, du nucléaire, et surtout du capital à une vitesse jamais observée dans l'histoire technologique.

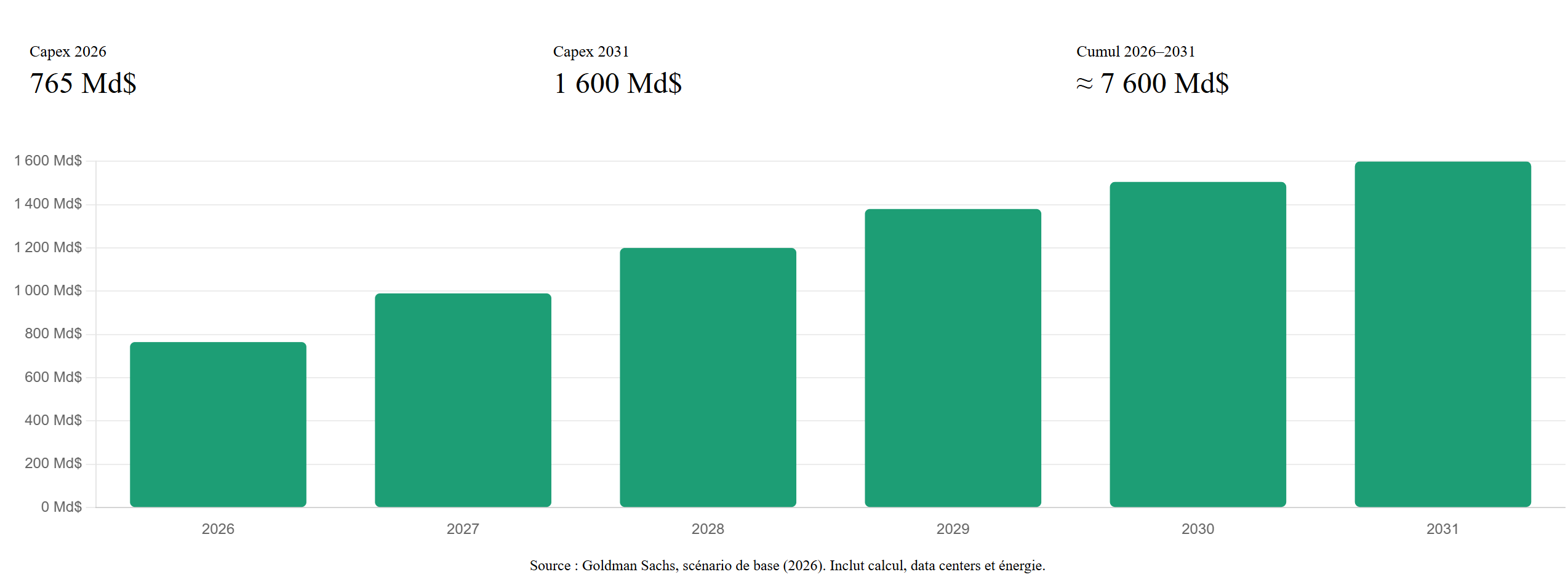

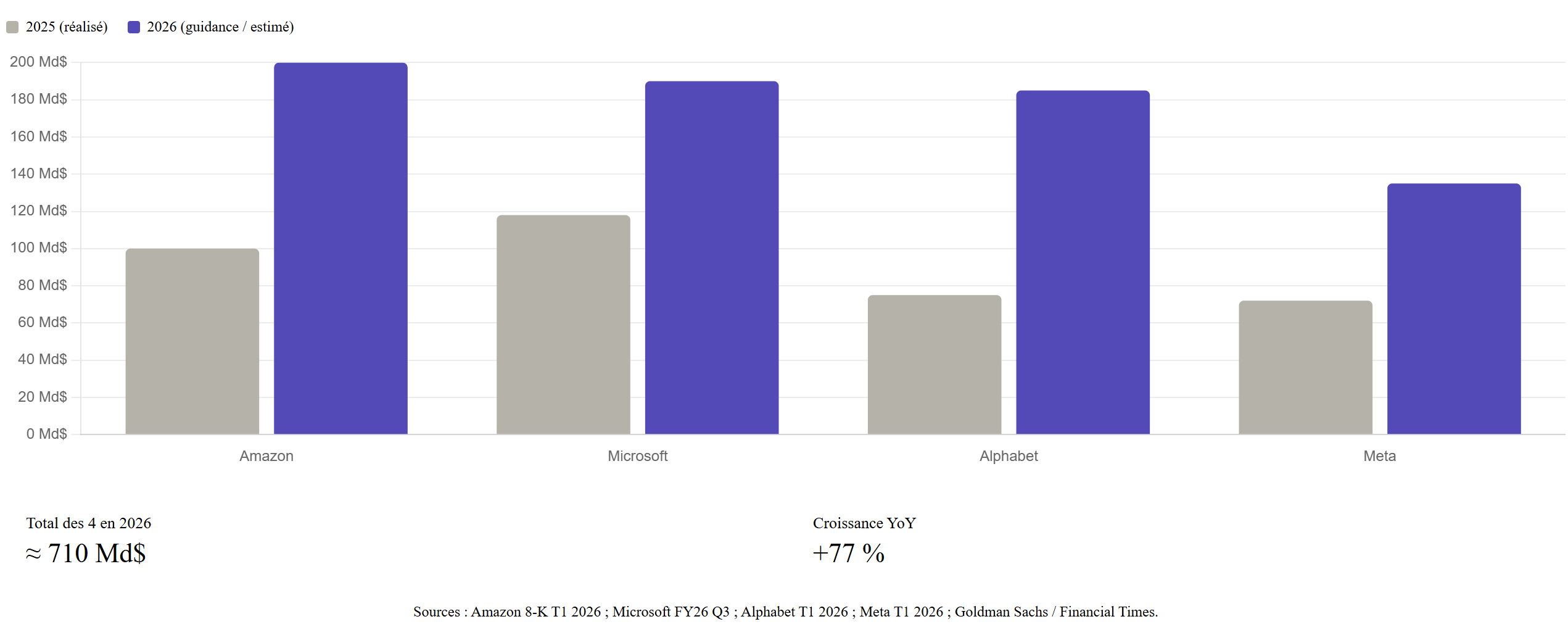

Le changement d'échelle se voit dans un chiffre. Selon les estimations reprises par le Financial Times, les seuls Amazon, Microsoft, Alphabet et Meta pourraient porter leurs dépenses d'investissement 2026 à environ 725 milliards de dollars, soit près de 77 % de plus que l'année précédente. Goldman Sachs propose une lecture encore plus large : son scénario de base estime le capex IA mondial à 765 milliards de dollars en 2026, puis à 1 600 milliards par an en 2031, pour un total cumulé d'environ 7 600 milliards entre 2026 et 2031. La direction de NVIDIA va plus loin : sa directrice financière Colette Kress a évoqué, lors des résultats du T4 FY2026, un niveau d'investissement annuel mondial dans l'infrastructure IA pouvant atteindre 3 000 à 4 000 milliards de dollars d'ici 2029-2030.

Cette dépense ne finance pas seulement des serveurs. Elle finance une nouvelle couche d'infrastructure productive : data centers, accélérateurs, réseaux optiques, refroidissement liquide, interconnexions, centrales électriques, contrats d'achat d'énergie, dette obligataire et partenariats de long terme. Le projet Stargate, annoncé par OpenAI, SoftBank, Oracle et MGX, illustre cette mutation : 500 milliards de dollars annoncés sur quatre ans pour construire une capacité IA de 10 gigawatts aux États-Unis.

La question centrale n'est donc plus seulement : « quel modèle est le meilleur ? ».

Elle devient : qui peut financer, alimenter, fabriquer et amortir l'infrastructure nécessaire pour faire tourner les modèles frontière ? (terme désignant les modèles les plus avancés).

La nouvelle échelle des dépenses

Le capex IA a changé de nature. Dans le logiciel classique, la croissance reposait surtout sur des ingénieurs, des serveurs mutualisés et des marges très élevées. Dans l'IA générative, la croissance repose sur une infrastructure physique qui doit être construite avant que les revenus ne soient pleinement garantis.

Le point décisif est que ces dépenses ne sont plus marginales. Elles représentent une part croissante de la formation brute de capital fixe américaine. Dans une lecture optimiste, cela ressemble à l'électrification, au rail ou à la fibre optique : une phase d'investissement massif précède la productivité. Dans une lecture pessimiste, cela ressemble à une course à l'armement financée par dette et contrats croisés, dont la rentabilité dépend d'une monétisation encore incomplète.

Goldman Sachs insiste sur quatre variables qui déplacent fortement le total : la durée économique des puces IA, le coût par mégawatt des nouveaux data centers, le mix entre GPU généralistes et puces spécialisées, et les goulets d'étranglement liés à l'énergie, aux permis, aux transformateurs et à la main-d'œuvre spécialisée.

Les hyperscalers américains : la course au capex

Les cinq groupes qui structurent le cycle américain sont Amazon, Microsoft, Alphabet, Meta et Oracle. Leur contrainte stratégique est simple : ralentir les dépenses revient à perdre de la capacité de calcul, donc à perdre des clients IA, des développeurs, des modèles et des revenus futurs.

Amazon et AWS

Amazon a publié un premier trimestre 2026 d'une qualité opérationnelle remarquable : 181,5 milliards de dollars de chiffre d'affaires, en hausse de 17 %, dont 37,6 milliards pour AWS, en hausse de 28 %, soit la plus forte accélération en quinze trimestres. AWS a généré 14,2 milliards de dollars de résultat opérationnel sur le trimestre, contribuant à 59 % du résultat opérationnel du groupe alors qu'il ne pèse que 21 % du chiffre d'affaires. Amazon a annoncé un capex trimestriel de 44,2 milliards de dollars (43,2 Md$ en cash capex), soit le double du T1 2025, et indique viser environ 200 milliards de dollars de capex total sur l'année 2026, ce qui en fait le premier investisseur en infrastructure IA en valeur absolue.

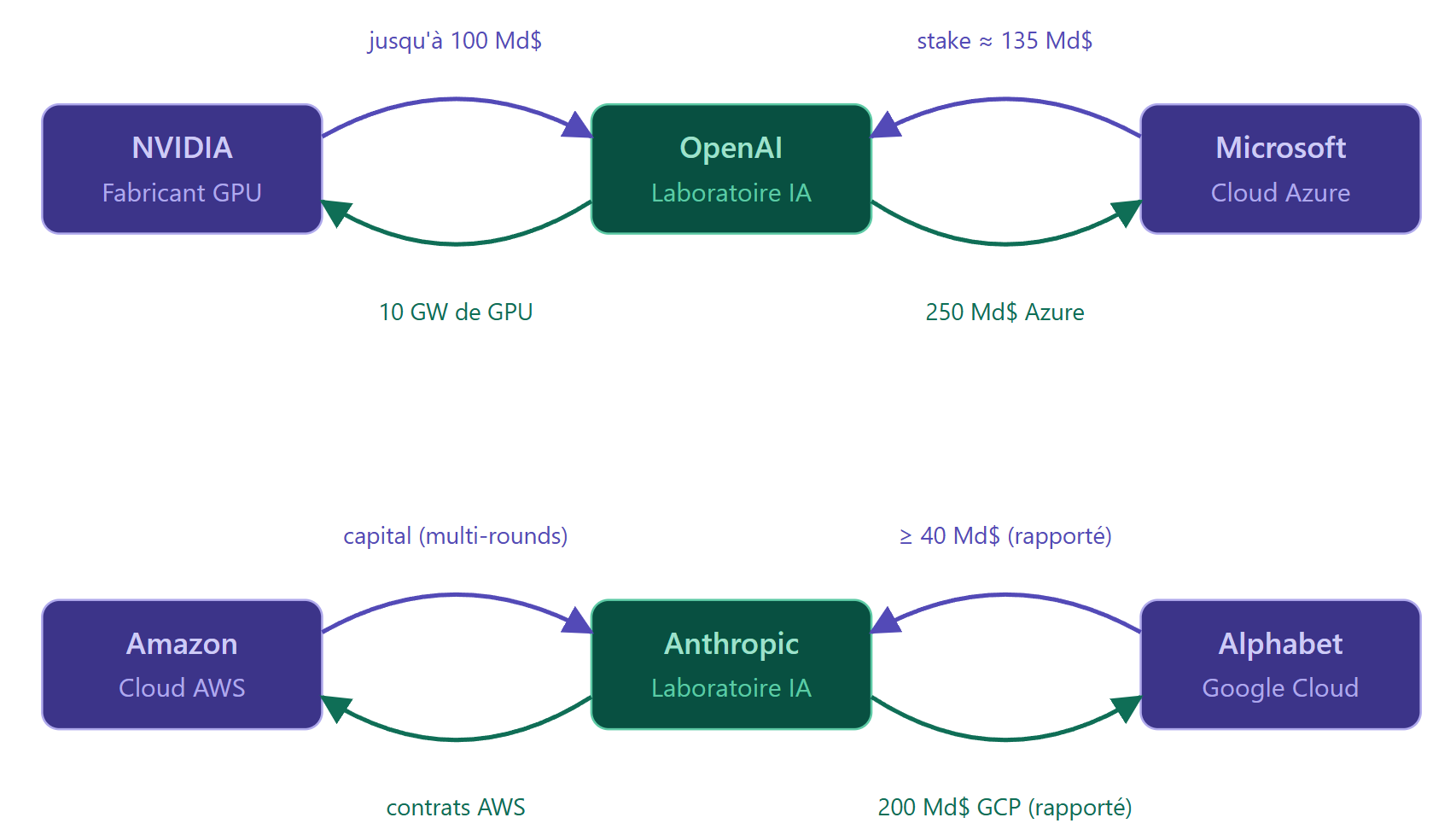

Le point critique pour l'économie de l'IA est ailleurs. Le free cash flow sur douze mois est tombé à 1,2 milliard de dollars, contre 25,9 milliards un an plus tôt, principalement à cause de l'augmentation de 59,3 milliards de dollars des achats de propriétés et équipements liés aux investissements IA. La société devient ainsi un cas d'école : AWS accélère, mais l'IA transforme une machine à cash flow en machine à investissement. Andy Jassy, son directeur général, a explicitement reconnu en earnings call que le capex doit être engagé six à vingt-quatre mois avant la facturation des clients, et que la phase actuelle pèsera sur le free cash flow jusqu'à ce que le revenu rattrape l'investissement. La société dispose d'un avantage structurel : sa base cloud, son partenariat Trainium, son alliance avec Anthropic (dont la réévaluation a contribué à hauteur de 16,8 milliards de dollars au résultat avant impôts du trimestre). En T1 2026, Amazon indique que son revenue run-rate IA chez AWS dépasse 15 milliards de dollars, que son activité de silicium maison (Graviton + Trainium + Nitro) atteint un run-rate consolidé supérieur à 20 milliards de dollars en croissance de plus de 100%, et qu'AWS détient désormais plus de 225 milliards de dollars d'engagements de revenus spécifiquement liés à Trainium. Le backlog total d'AWS était de 364 milliards à la clôture du trimestre, avant l'annonce du contrat Anthropic supérieur à 100 milliards évoqué en call.

Microsoft et Azure

Microsoft a publié au premier trimestre fiscal 2026 (29 octobre 2025) un chiffre d'affaires de 77,7 milliards de dollars (+18 %), un résultat opérationnel de 38 milliards (+24 %), un Microsoft Cloud à 49,1 milliards et un RPO à 392 milliards (+51 %), avec Azure en croissance de 40 % sur un an et un capex trimestriel de 34,9 milliards de dollars. Six mois plus tard, le 29 avril 2026, le groupe a publié son troisième trimestre fiscal 2026 : 82,9 milliards de revenus (+18 %), 38,4 milliards de résultat opérationnel (+20 %), Microsoft Cloud à 54,5 milliards (+29 %), Azure à nouveau à +40 %, un RPO à 627 milliards (+99 %), un run-rate IA atteignant 37 milliards (+123 %) et un capex trimestriel de 31,9 milliards. C'est lors de cette publication d'avril 2026 que la directrice financière Amy Hood a fixé la guidance de capex pour l'année calendaire 2026 à environ 190 milliards de dollars (soit +61 % vs 2025), dont environ 25 milliards directement imputables à la hausse des prix des composants — principalement la mémoire — face à un consensus analystes de 154,6 milliards.

La relation avec OpenAI reste centrale. Après la restructuration du partenariat, Microsoft détient une participation valorisée à environ 135 milliards de dollars dans OpenAI Group PBC, soit environ 27 % sur une base diluée. Surtout, l'accord renégocié intègre 250 milliards de dollars d'engagements Azure additionnels signés par OpenAI, qui s'ajoutent aux contrats commerciaux du trimestre et donnent une visibilité longue à l'activité cloud de Microsoft.

Alphabet et Google Cloud

Alphabet bénéficie d'un avantage différent : l'intégration verticale et un cycle de monétisation IA déjà engagé dans le moteur de recherche. Le groupe a publié au T1 2026 un chiffre d'affaires de 109,9 milliards de dollars (+22 %, plus forte croissance trimestrielle depuis 2022), un résultat net de 62,6 milliards et un capex trimestriel de 35,7 milliards. Google Cloud a franchi pour la première fois 20 milliards de dollars de revenus trimestriels (+63 %), avec une marge opérationnelle de 32,9 % et un backlog proche de 462 milliards de dollars, presque doublé en un trimestre. Sundar Pichai a reconnu publiquement que Cloud aurait pu croître plus vite si la capacité de calcul n'était pas saturée. La société a relevé sa guidance 2026 de capex à 180-190 milliards de dollars (incluant l'acquisition d'Intersect) et indiqué que le capex 2027 augmentera « significativement » au-dessus de 2026. Alphabet a financé une partie de cet effort par 31,1 milliards d'obligations senior émises au T1 2026.

L'intégration verticale est stratégique. Dans un monde où les GPU sont rares, où la mémoire HBM renchérit les systèmes et où les délais d'interconnexion électrique s'allongent, posséder ses propres TPU (jusqu'à la septième génération en collaboration avec Broadcom) ne sert pas seulement à baisser les coûts unitaires : cela sert à sécuriser une trajectoire de capacité.

Meta

Meta a relevé sa fourchette de capex 2026 à 125-145 milliards de dollars, contre 115-135 milliards précédemment, soit presque le double des 72,2 milliards dépensés en 2025. La société explique cette hausse par le renchérissement des composants et par des coûts additionnels de data centers destinés à préparer la capacité des années futures. Au T1 2026, Meta a publié 56,3 milliards de dollars de revenus, en hausse de 33 %, soit la croissance la plus rapide depuis 2021.

Meta est un cas particulièrement intéressant parce qu'il finance simultanément plusieurs couches : ses propres modèles, ses produits grand public, ses infrastructures internes, des contrats avec des neoclouds, et son silicium MTIA. En avril 2026, Meta a signé un contrat de 21 milliards de dollars supplémentaires avec CoreWeave, venant s'ajouter à un accord de 14,2 milliards signé précédemment. En février 2026, Meta a aussi conclu avec AMD un accord miroir de celui d'OpenAI : 6 GW d'Instinct GPU MI450, premier déploiement au second semestre 2026, et warrants portant sur jusqu'à 160 millions d'actions AMD, soit environ 10 % du capital, conditionnés à l'atteinte d'objectifs commerciaux et de cours.

Oracle

Oracle est le cas le plus atypique. Sa trajectoire IA dépend fortement des contrats liés à OpenAI et à Stargate. Le Wall Street Journal, repris par Reuters, a rapporté qu'OpenAI avait signé avec Oracle un contrat d'environ 300 milliards de dollars sur cinq ans pour acheter de la puissance de calcul, ce qui pourrait représenter près d'un tiers du chiffre d'affaires d'Oracle à l'horizon 2028. Côté officiel, OpenAI et Oracle ont annoncé une capacité additionnelle de 4,5 GW dans le cadre de Stargate, pour porter la capacité en construction à plus de 5 GW et plus de 2 millions de puces. Les projections officielles communiquées au moment de la publication des résultats du T1 fiscal 2026 — alors que Safra Catz, désormais Executive Vice Chair du conseil après la transition de septembre 2025 vers une structure à co-CEO assurée par Clay Magouyrk et Mike Sicilia, accompagnait encore la communication financière — placent Oracle Cloud Infrastructure (OCI) en hausse de 77 % à 18 milliards de dollars sur l'exercice 2026, puis 32, 73, 114 et 144 milliards sur les quatre exercices suivants.

Le risque est évident : Oracle peut devenir un gagnant majeur si les contrats sont exécutés, mais son profil financier devient plus sensible à la concentration client, à la dette (estimée autour de 111 milliards de dollars) et aux délais de construction. Sur les premiers mois de 2026, l'action a corrigé d'environ 24 %, signe que le marché commence à exiger des preuves d'exécution.

Le pivot matériel : NVIDIA, Broadcom, AMD, TSMC

L'économie de l'IA est d'abord une économie de semi-conducteurs. Les modèles attirent l'attention, mais les marges les plus spectaculaires sont captées par les fournisseurs de calcul.

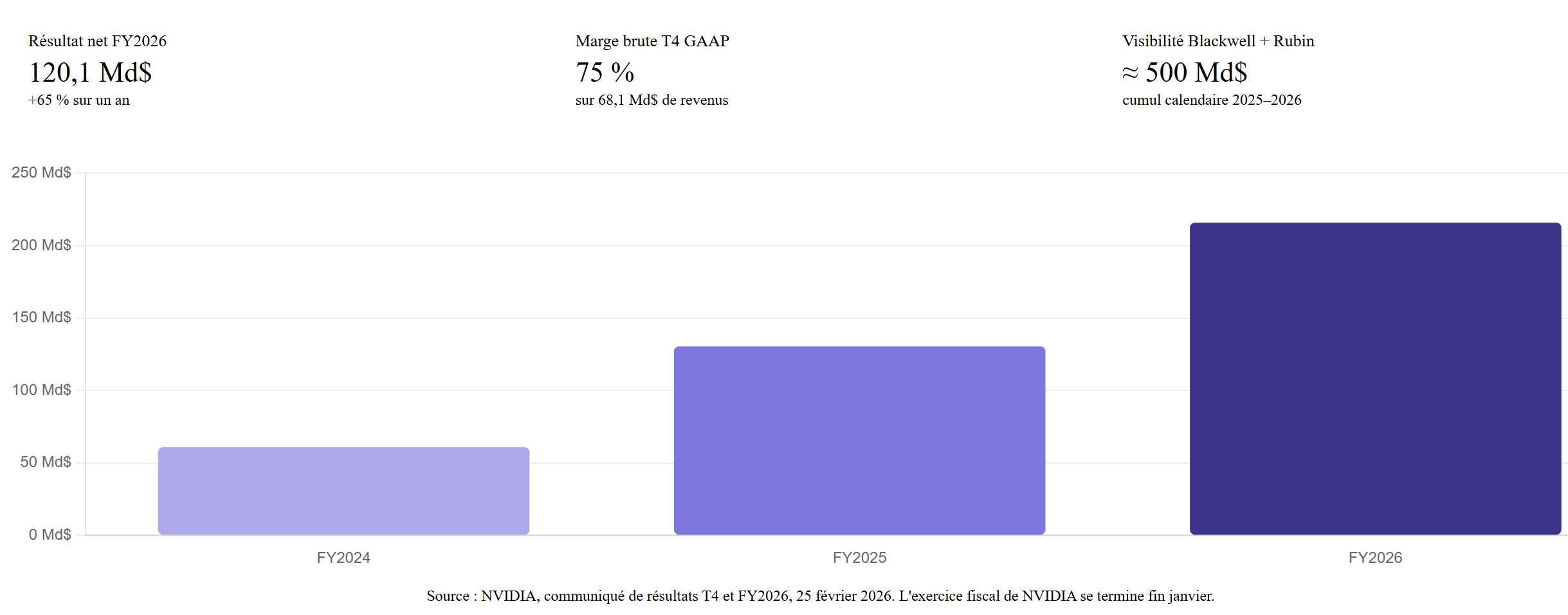

NVIDIA, le péage central de l'IA

NVIDIA a clos un exercice fiscal 2026 historique : 215,9 milliards de dollars de chiffre d'affaires annuel (+65 %), 130,4 milliards de résultat opérationnel GAAP, 120,1 milliards de bénéfice net (+65 %), et 41,1 milliards de dollars retournés aux actionnaires sur l'année. Le quatrième trimestre seul a atteint 68,1 milliards de dollars de revenus (+73 % sur un an), dont 62,3 milliards pour le segment Data Center. La marge brute GAAP du trimestre atteint 75 %. Pour le premier trimestre fiscal 2027, la société guide à 78 milliards de dollars de revenus.

Ces chiffres changent le statut économique de NVIDIA. Ce n'est plus seulement un fournisseur de composants : c'est un goulet d'étranglement monétisé. Sa CFO, Colette Kress, a indiqué disposer d'une visibilité de 500 milliards de dollars de revenus Blackwell et Rubin cumulés entre l'année calendaire 2025 et la fin 2026. Selon plusieurs analystes du secteur des fonderies, NVIDIA serait devenu le premier client de TSMC en 2025, avec environ 19 % du chiffre d'affaires de la fonderie, devant Apple (autour de 17 %) — TSMC ne nomme pas explicitement ses clients dans ses ventilations publiques.

NVIDIA capte aussi une partie de l'option stratégique via ses prises de participation. La société a annoncé une lettre d'intention avec OpenAI pour déployer au moins 10 GW de systèmes NVIDIA, avec une intention d'investir jusqu'à 100 milliards de dollars dans OpenAI au fur et à mesure du déploiement de chaque gigawatt. Le premier gigawatt est ciblé pour la seconde moitié de 2026 sur la plateforme Vera Rubin. NVIDIA est aussi entrée au capital de CoreWeave à hauteur de 2 milliards de dollars en janvier 2026, et figure parmi les investisseurs stratégiques de xAI et d'OpenAI.

Broadcom, le roi du custom silicon

Broadcom est l'autre gagnant majeur du cycle. Au T1 fiscal 2026, la société a publié 19,3 milliards de dollars de revenus consolidés (+29 %), dont 8,4 milliards de revenus IA (+106 %), et a guidé 22 milliards de dollars de revenus consolidés au T2 (dont 10,7 milliards de revenus IA). Hock Tan, son directeur général, a déclaré viser plus de 100 milliards de dollars de revenus IA d'ici 2027.

Son rôle est structurel : Broadcom aide Google, Meta, OpenAI et Anthropic à concevoir des accélérateurs spécialisés (XPU). Si le GPU généraliste de NVIDIA reste imbattable pour la flexibilité, les ASIC maison deviennent très attractifs pour les charges répétitives, l'inference, les volumes massifs et la réduction du coût par token. L'annonce officielle conjointe OpenAI/Broadcom du 13 octobre 2025 confirme une collaboration sur 10 GW d'accélérateurs IA conçus par OpenAI et déployés en partenariat avec Broadcom, avec un démarrage des racks au second semestre 2026 et une fin de déploiement visée pour 2029.

AMD, l'alternative GPU crédible

AMD reste l'alternative généraliste la plus crédible à NVIDIA. L'accord annoncé en octobre 2025 avec OpenAI porte sur 6 GW de GPU Instinct à déployer sur plusieurs générations, à partir de la seconde moitié de 2026 avec le MI450. Le contrat inclut un warrant permettant à OpenAI d'acquérir jusqu'à 160 millions d'actions AMD, soit environ 10 % du capital, à un prix d'exercice de 0,01 dollar, conditionné au déploiement effectif de chaque gigawatt et à l'atteinte d'un cours pouvant aller jusqu'à 600 dollars. AMD a répliqué cette structure avec Meta en février 2026, pour un volume cible et une part en capital équivalents.

Pour AMD, transformer deux laboratoires de modèles frontière en clients structurants peut changer l'échelle du segment IA, dont les revenus 2025 étaient encore d'environ 6,5 milliards de dollars contre 115 milliards pour la division Data Center de NVIDIA. Pour le marché, cela crée une deuxième référence de prix et de performance face à la domination des architectures CUDA, et offre aux grands clients une marge de négociation accrue face à NVIDIA.

TSMC, le goulet d'étranglement absolu

TSMC est l'infrastructure derrière l'infrastructure. Sans ses nœuds avancés, ni les GPU de NVIDIA, ni les TPU de Google, ni les accélérateurs de Broadcom, ni les puces d'Apple ne peuvent être produits à grande échelle.

Les chiffres confirment l'ampleur du levier. TSMC a généré environ 3 810 milliards de dollars taïwanais de chiffre d'affaires en 2025, en hausse de 31,6 %, avec un bénéfice net record. Au quatrième trimestre 2025, le calcul haute performance (HPC) représentait 55 % des revenus du trimestre et 58 % des revenus annuels, en croissance de 48 % sur un an. La société a entamé la production en volume du nœud N2 dans ses usines de Hsinchu et Kaohsiung. Pour 2026, TSMC prévoit une croissance de revenus supérieure à 30 % en dollars et un capex de 52 à 56 milliards de dollars, désormais ciblé sur le haut de fourchette ; les nœuds avancés (7 nm et inférieurs) représentent 74 % des revenus du T1 2026, dont 36 % pour le 5 nm et 25 % pour le 3 nm.

Cela fait de TSMC le point de vulnérabilité géopolitique central. Une crise durable autour de Taïwan ne toucherait pas seulement une entreprise : elle toucherait l'ensemble du stack IA mondial. Le directeur général C.C. Wei a confirmé en mars 2026 sa confiance dans la durabilité de la demande IA, tout en avertissant que le capex requis pour produire 1 000 wafers par mois en N2 est « substantiellement plus élevé » qu'en N3, et plus encore en A14 (1,4 nm).

SK Hynix, Samsung, Micron : le goulet de la mémoire haute bande passante

À côté du calcul, la mémoire haute bande passante (HBM) est devenue le second goulet d'étranglement physique du cycle. SK Hynix domine le marché HBM, avec une part estimée entre 57 % et plus de 60 % selon les analystes du secteur, et reste un fournisseur clé de NVIDIA ; les estimations de presse évoquent une part très majoritaire des besoins NVIDIA mais sans chiffrage officiel. Sur la prochaine génération HBM4, qui équipera la plateforme Vera Rubin à partir du second semestre 2026, des sources industrielles rapportées par TrendForce indiquent que le coréen aurait sécurisé la plus grande part de l'allocation NVIDIA, autour de 60 %, sans confirmation officielle ; il a finalisé son procédé de packaging en partenariat avec TSMC.

Samsung et Micron rattrapent leur retard, mais avec des contraintes. Selon plusieurs rapports d'industrie non officiels, les rendements et la capacité HBM4 chez les fournisseurs mémoire restent contraints au premier trimestre 2026 — insuffisants pour couvrir la totalité de la demande NVIDIA. Devant ces tensions, NVIDIA aurait envisagé d'assouplir ses spécifications, en acceptant des variantes HBM4 à 10,6 Gbps en plus du standard 11,7 Gbps, pour sécuriser le volume d'approvisionnement. Le passage suivant, le HBM4E en piles 16 couches, attendu à partir de fin 2026, exige des dies fortement amincis, un saut technique décrit par les industriels du secteur comme substantiellement plus difficile que le passage de 8 à 12 couches.

La conséquence économique est directe. Tant que les rendements et la capacité HBM4 ne se stabilisent pas, le coût des systèmes NVIDIA reste élevé, l'élasticité-prix limitée, et les marges des fournisseurs de calcul protégées. C'est l'un des facteurs susceptibles de soutenir les marges brutes de NVIDIA autour de 75 % tant que l'offre de systèmes accélérés reste contrainte.

Les neoclouds : vendre du calcul rare comme une matière première

Les neoclouds occupent l'espace entre les grands hyperscalers et les laboratoires. Leur promesse est simple : louer rapidement du calcul IA spécialisé quand les grands clouds sont saturés ou trop généralistes.

CoreWeave

CoreWeave est l'exemple le plus spectaculaire. En 2025, la société est devenue le cloud le plus rapide de l'histoire à atteindre 5 milliards de dollars de revenus annuels. Elle a publié 5,13 milliards de dollars de chiffre d'affaires (+168 %), un backlog de 66,8 milliards de dollars (multiplié par plus de quatre), une capacité contractuelle de 3,1 GW et une durée moyenne pondérée des contrats désormais portée à cinq ans. Au T4 2025, le revenu trimestriel a doublé à 1,57 milliard de dollars, mais la perte nette a atteint 452 millions et les charges d'intérêts 388 millions. Le capex trimestriel a atteint 4,06 milliards de dollars.

Le modèle est limpide : croissance explosive, mais très forte intensité capitalistique. CoreWeave guide pour 2026 un capex d'au moins 30 milliards de dollars, plus du double de 2025, et un run-rate de revenus à la sortie d'année entre 17 et 19 milliards, avec un objectif supérieur à 30 milliards fin 2027. La valeur de CoreWeave dépend de sa capacité à financer des GPU, à remplir ses sites, à conserver des clients de grande qualité et à refinancer sa dette à des taux acceptables.

Le contrat de 6,3 milliards de dollars signé avec NVIDIA, par lequel NVIDIA s'engage à acheter la capacité invendue de CoreWeave jusqu'au 13 avril 2032, et l'investissement direct de 2 milliards de NVIDIA au capital en janvier 2026, sécurisent CoreWeave mais alimentent les critiques sur la circularité financière de l'écosystème.

Nebius

Nebius suit une logique proche, avec une empreinte européenne et une ambition full-stack. En mars 2026, la société a signé avec Meta un accord portant sur 12 milliards de dollars de capacité IA d'ici 2027, avec une option additionnelle de 15 milliards si la capacité prévue n'est pas vendue à d'autres clients, soit jusqu'à 27 milliards de dollars au total. Ce type de contrat illustre l'évolution du marché : les grandes plateformes ne se contentent plus de construire leurs propres data centers, elles préachètent aussi de la capacité chez des spécialistes pour réduire le risque de manquer de calcul.

Les laboratoires IA : revenus réels, pertes massives, valorisations extrêmes

Les laboratoires de modèles fondamentaux sont les clients, les partenaires et parfois les actionnaires de l'infrastructure. Ils transforment le calcul en produits : abonnements, API, agents de code, assistants entreprise, outils multimodaux, intégrations métier.

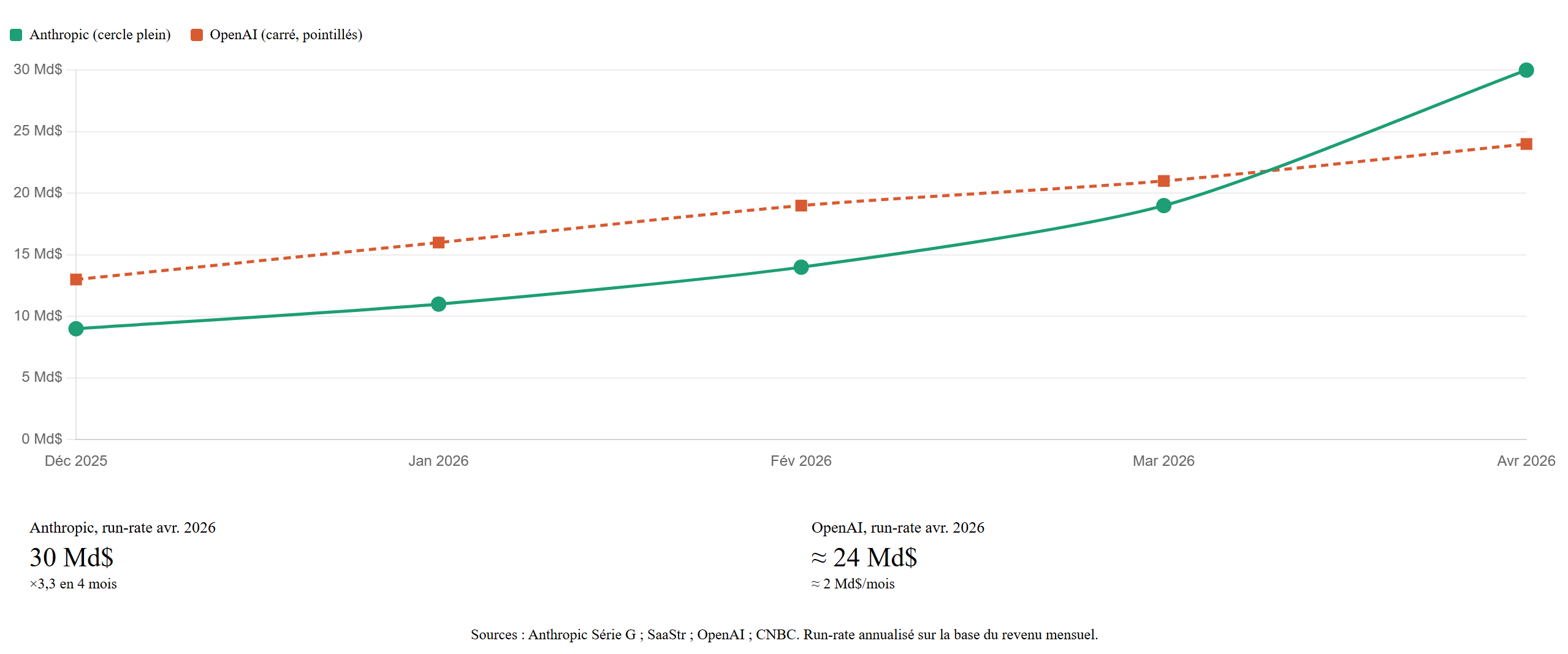

OpenAI

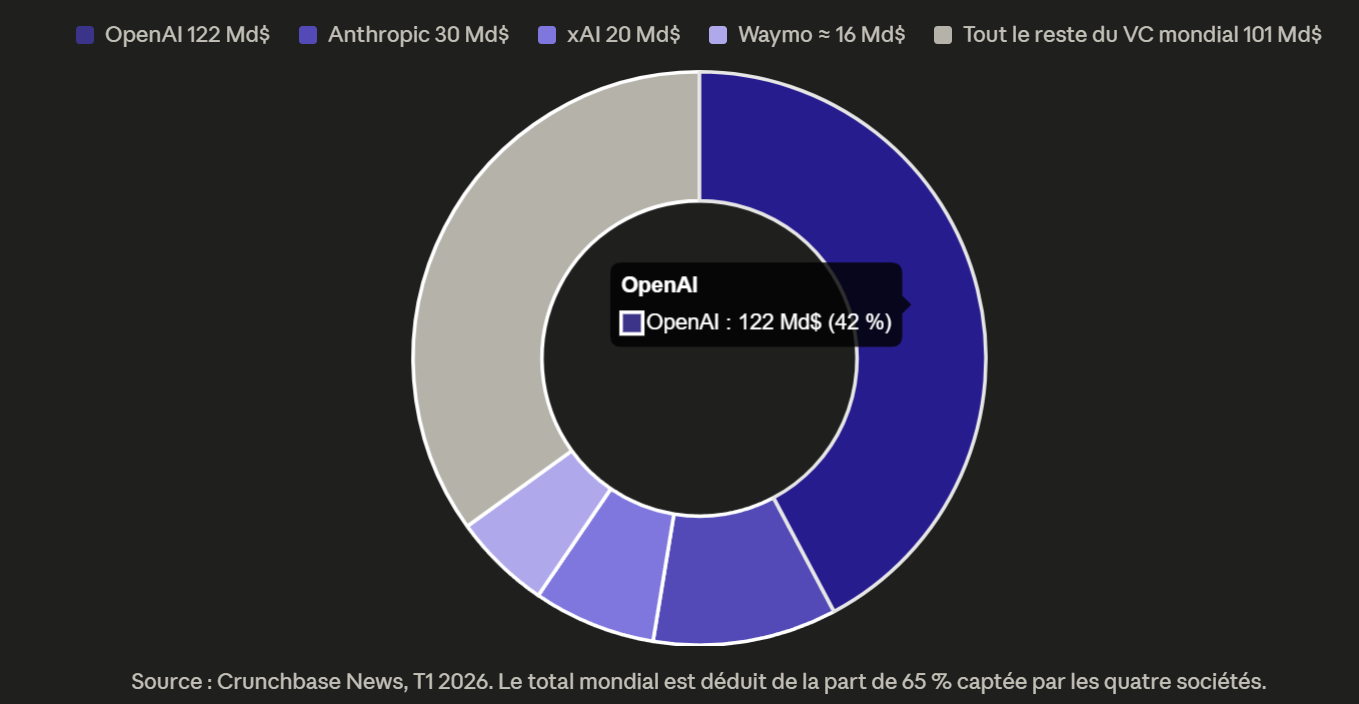

OpenAI revendique plus de 900 millions d'utilisateurs hebdomadaires actifs pour ChatGPT et plus de 50 millions d'abonnés grand public, ainsi que 9 millions d'utilisateurs entreprise payants. La société génère environ 2 milliards de dollars de revenus par mois, soit un run-rate proche de 24 milliards de dollars. En 2025, le chiffre d'affaires a atteint 13,1 milliards de dollars, dépassant l'objectif interne de 10 milliards, pour une consommation de trésorerie de 8 milliards. La société projetait une perte d'environ 14 milliards en 2026 et n'attendait pas de free cash flow positif avant 2029.

En février-mars 2026, OpenAI a clos une Série G de 122 milliards de dollars à une valorisation post-money de 852 milliards, conduite par SoftBank, avec 50 milliards engagés par Amazon, 30 milliards par NVIDIA, 30 milliards par SoftBank, et la participation de Microsoft, Andreessen Horowitz, D. E. Shaw Ventures, MGX, TPG, T. Rowe Price, BlackRock, Blackstone, Coatue, Sequoia, Temasek et d'autres. Trois milliards de dollars ont été levés via des canaux bancaires auprès d'investisseurs particuliers, une première pour le groupe. La société a aussi étendu sa ligne de crédit revolving à environ 4,7 milliards de dollars.

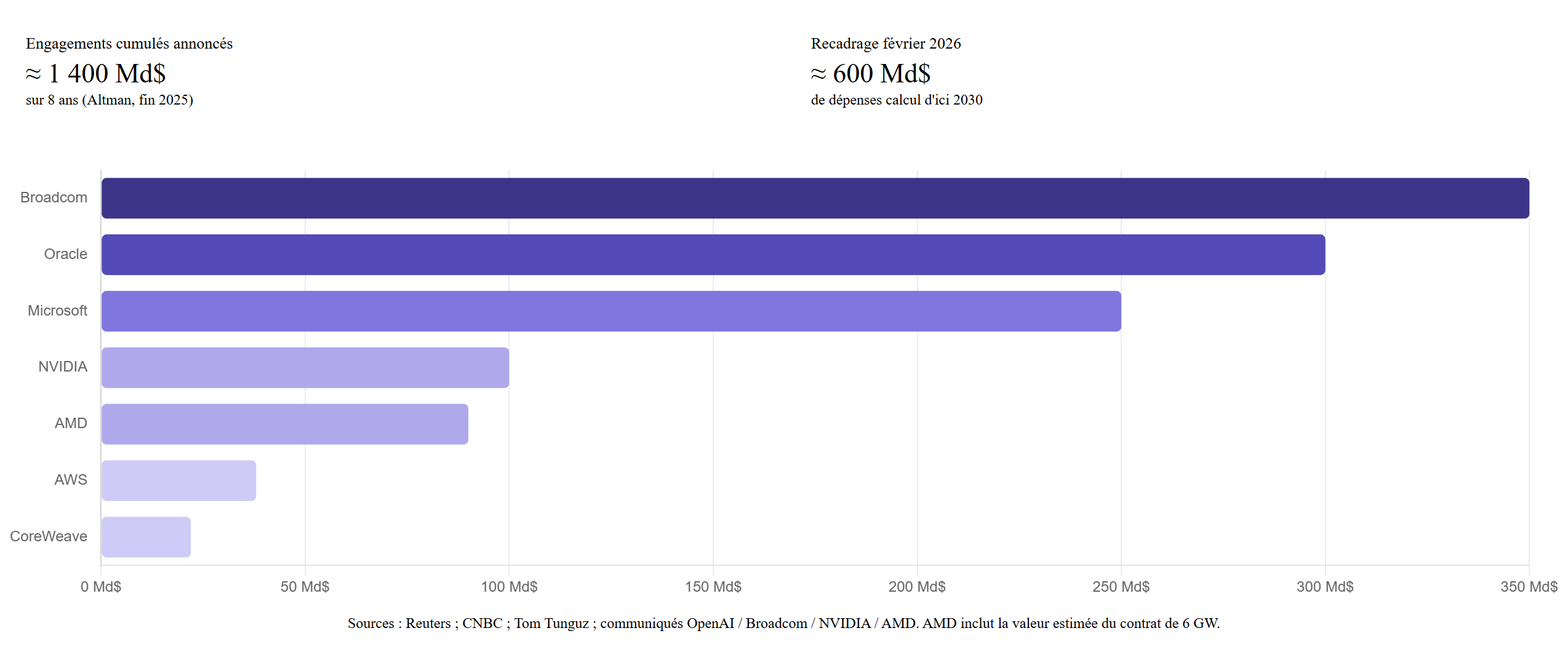

Cette adoption impose une contrainte physique extrême. OpenAI ne peut pas croître comme une simple application SaaS : chaque hausse d'usage augmente la demande de calcul, surtout avec les agents, le code, la multimodalité et les longs contextes. Sam Altman avait évoqué fin 2025 un total de 1 400 milliards de dollars d'engagements infrastructure cumulés sur huit ans, répartis grossièrement entre Broadcom (350 Md$), Oracle (300 Md$), Microsoft (250 Md$), NVIDIA (100 Md$), AMD (~90 Md$ en valeur estimée), AWS (38 Md$ sur sept ans) et CoreWeave (22,4 Md$). En février 2026, la société a recalibré ce chiffre auprès de ses investisseurs : environ 600 milliards de dollars de dépenses de calcul d'ici 2030, lié à un objectif de revenus 2030 supérieur à 280 milliards. Le 5 mai 2026, le président Greg Brockman a précisé que les dépenses de calcul du groupe atteindraient environ 50 milliards de dollars sur l'année 2026, contre 30 millions en 2017, et a confirmé que sa propre participation dans la société était valorisée à environ 30 milliards. À cette date, OpenAI est valorisée à plus de 850 milliards de dollars par les investisseurs privés.

Anthropic

Anthropic a levé 30 milliards de dollars en Série G le 12 février 2026, à une valorisation post-money de 380 milliards, mené par GIC et Coatue, co-mené par D. E. Shaw Ventures, Dragoneer, Founders Fund, ICONIQ et MGX, avec la participation de BlackRock, Blackstone, Fidelity, Goldman Sachs, Greenoaks, Qatar Investment Authority, Sequoia et Temasek.

La trajectoire revenus est sans équivalent connu dans le software d'entreprise. Selon Anthropic, son run-rate est passé d'environ 9 milliards de dollars fin 2025 à 14 milliards lors de la Série G en février 2026, puis à plus de 30 milliards début avril 2026 — un niveau qui place le laboratoire au-dessus du run-rate d'environ 25 milliards rapporté par OpenAI à la même date. Claude Code génère un run-rate supérieur à 2,5 milliards de dollars, le nombre d'utilisateurs hebdomadaires a doublé depuis janvier 2026, et selon une analyse de SemiAnalysis (et non d'Anthropic) environ 4 % des commits publics mondiaux sur GitHub étaient écrits par Claude Code au moment de la levée. Lors de la Série G de février 2026, Anthropic indiquait que plus de 500 clients dépensaient plus d'un million de dollars annualisés ; ce chiffre a doublé en moins de deux mois pour dépasser 1 000 clients à la date de l'annonce du 6 avril 2026, et huit des dix premiers groupes du Fortune 10 sont clients.

Cette traction s'inscrit dans un mouvement plus large d'adoption des agents IA en entreprise. Selon le Gartner CIO and Technology Executive Survey 2026, 17 % des organisations ont déployé au moins un agent IA en production, et plus de 60 % comptent le faire dans les deux ans, soit la courbe d'adoption la plus agressive parmi toutes les technologies émergentes mesurées par Gartner. Le cabinet projette que 40 % des applications d'entreprise intégreront des agents spécialisés à fin 2026, contre moins de 5 % en 2025, et estime les dépenses logicielles d'agents IA à 206,5 milliards de dollars en 2026, puis 376,3 milliards en 2027, contre 86,4 milliards en 2025. Le même cabinet avertit toutefois que jusqu'à 40 % des projets agentiques pourraient être annulés d'ici 2027 faute de retour sur investissement clair, ce qui décrit un marché où l'adoption nominale précède la maturité opérationnelle.

Le 5 mai 2026, The Information, a rapporté qu'Anthropic se serait engagé à dépenser 200 milliards de dollars sur cinq ans avec Google Cloud (combinant infrastructure et puces TPU co-conçues avec Broadcom), engagement qui représenterait à lui seul plus de 40 % du backlog cloud de 460 milliards révélé par Alphabet la semaine précédente. Selon ces mêmes reportages, les contrats cumulés d'Anthropic et OpenAI représenteraient désormais plus de la moitié du backlog agrégé d'environ 2 000 milliards de dollars d'AWS, Azure et Google Cloud — un degré de concentration sans précédent. En parallèle, Alphabet aurait porté son investissement total dans Anthropic à plus de 40 milliards de dollars supplémentaires (10 milliards apportés immédiatement, 30 milliards conditionnés à des jalons de performance), à une valorisation d'environ 350 milliards. Ces chiffres ne sont pas confirmés directement par les deux sociétés, mais ils sont cohérents avec les projections de revenus internes d'Anthropic rapportées par le Wall Street Journal (18 milliards en 2026, 55 en 2027, 102 en 2028, 148 en 2029).

L'économie d'Anthropic reste néanmoins déficitaire. La société a levé des dizaines de milliards de dollars cumulés, dont 30 milliards lors de la seule Série G de février 2026, et plus de 13 milliards lors de la Série F de septembre 2025. Le partenariat avec Microsoft et NVIDIA annoncé fin 2025 prévoit jusqu'à 15 milliards d'investissements de leur part, en parallèle d'achats d'environ 30 milliards de dollars de calcul Azure par Anthropic, dans un schéma là encore qualifié de circulaire par certains analystes.

xAI

xAI a annoncé en janvier 2026 une Série E de 20 milliards de dollars, supérieure à la cible initiale de 15 milliards, à une valorisation d'environ 230 milliards rapportée par des sources secondaires (le communiqué officiel xAI confirme la levée de 20 Md$ et la liste d'investisseurs, mais ne donne pas de valorisation). Parmi les investisseurs figurent Valor Equity Partners, Stepstone Group, Fidelity, Qatar Investment Authority, MGX, Baron Capital Group, ainsi que NVIDIA et Cisco comme investisseurs stratégiques. La société exploite les supercalculateurs Colossus I et Colossus II ; selon des reprises de presse non confirmées par le communiqué officiel, la capacité combinée dépasserait l'équivalent d'un million de H100, avec un objectif d'extension supplémentaire en 2026. Selon TechCrunch, xAI revendique environ 600 millions d'utilisateurs mensuels actifs cumulés sur ses applications Grok et X ; ce chiffre agrège les usages du réseau social et du chatbot, et n'apparaît pas dans le communiqué officiel xAI.

xAI est un cas hybride : laboratoire IA, produit grand public via Grok, actif stratégique lié à X, et projet d'infrastructure géant via les clusters de calcul. Il illustre la convergence entre modèles, distribution sociale, puissance de calcul et capital souverain.

Stargate : l'IA comme politique industrielle

Stargate marque un tournant : l'IA devient explicitement un sujet de souveraineté industrielle américaine. Le projet annoncé le 21 janvier 2025 à la Maison-Blanche prévoit jusqu'à 500 milliards de dollars sur quatre ans, avec un déploiement initial de 100 milliards et un objectif de 10 GW.

En septembre 2025, OpenAI, Oracle et SoftBank ont annoncé cinq nouveaux sites américains : Shackelford County (Texas), Doña Ana County (Nouveau-Mexique), un site dans le Wisconsin, Lordstown (Ohio) et Milam County (Texas). Avec Abilene (Texas, 1,2 GW déjà partiellement opérationnel et alimenté en NVIDIA GB200), les projets CoreWeave et ces nouveaux sites, Stargate atteint près de 7 GW de capacité planifiée et plus de 400 milliards de dollars d'investissement sur trois ans. JPMorgan Chase a fourni dès mai 2025 un prêt de 2,3 milliards de dollars en project finance sur le site d'Abilene, signal que les grands prêteurs institutionnels considèrent le projet comme finançable.

Stargate a aussi pris une dimension internationale. Le premier nœud hors États-Unis, Stargate UAE, a été annoncé en mai 2025 dans le cadre du UAE-US AI Acceleration Partnership. Construit par Khazna Data Centres, filiale de G42, il est implanté dans un campus IA d'environ 5 GW au sud d'Abu Dhabi (les sources officielles G42 mentionnent une surface d'environ 10 milles carrés pour l'ensemble du campus UAE-US). Le projet associe OpenAI, Oracle, NVIDIA, Cisco et SoftBank, avec un coût projeté supérieur à 30 milliards de dollars pour le full buildout 1 GW. La première tranche de 200 MW, alimentée en NVIDIA Grace Blackwell GB300, est attendue opérationnelle au troisième trimestre 2026. En parallèle, le département du Commerce américain a autorisé G42 à importer l'équivalent de 35 000 puces GB300. Microsoft, qui a investi 1,5 milliard de dollars au capital de G42 en 2024, a annoncé en mars 2026 une enveloppe additionnelle de 7,9 milliards de dollars d'investissements aux Émirats entre 2026 et 2029, dont 5,5 milliards pour l'expansion de capacité IA et cloud, et a obtenu des licences d'export pour l'équivalent de 60 400 puces A100 (livrées sous forme de GB300).

Stargate Norway, annoncé en juillet 2025, prévoyait 230 MW initiaux à Narvik avec environ 100 000 GPU NVIDIA à fin 2026, en exploitant l'hydroélectricité abondante de la région. Le 15 avril 2026, CNBC et Bloomberg ont rapporté qu'OpenAI n'avait finalement pas conclu son accord d'offtake avec Nscale, le développeur britannique du site, et que Microsoft reprenait la capacité initialement destinée à OpenAI — Microsoft louera 30 000 puces NVIDIA Vera Rubin supplémentaires à Nscale, en plus d'un engagement préalable de 6,2 milliards de dollars sur le même site. OpenAI a indiqué qu'il accéderait à de la capacité en Norvège à travers Microsoft Azure plutôt qu'en direct. L'initiative OpenAI for Countries, lancée en février 2026, vise dix projets Stargate supplémentaires avec des États co-investisseurs ; le projet Stargate UK a été officiellement mis en pause par OpenAI le 9 avril 2026 en raison des coûts énergétiques et de contraintes réglementaires (Reuters).

La logique est géopolitique autant qu'économique. Le calcul devient une capacité stratégique, comme l'énergie, les semi-conducteurs ou les câbles sous-marins. Celui qui possède l'accès au calcul peut entraîner les modèles, servir les utilisateurs, vendre des API, intégrer l'IA aux administrations, aux armées et aux grandes entreprises.

Le financement circulaire : accélérateur industriel ou maison de cartes ?

Le cycle actuel repose sur des flux financiers croisés. C'est l'un des points les plus sensibles de l'analyse.

NVIDIA peut investir jusqu'à 100 milliards de dollars dans OpenAI, tandis qu'OpenAI utilisera du capital pour acheter des systèmes NVIDIA. Reuters note que ce montage alimente les critiques de circularité : d'un côté il accélère la construction d'infrastructure, de l'autre il peut donner l'impression que le fournisseur finance sa propre demande.

NVIDIA a aussi signé avec CoreWeave un accord de 6,3 milliards de dollars qui garantit l'achat de capacité invendue jusqu'en 2032, et a investi 2 milliards de dollars supplémentaires au capital en janvier 2026. Microsoft a engagé plus de 13 milliards de dollars cumulés dans OpenAI et reçu en retour des engagements Azure de 250 milliards. OpenAI multiplie les contrats : 300 milliards de dollars chez Oracle, jusqu'à 100 milliards chez NVIDIA, jusqu'à 38 milliards chez AWS (avec 50 milliards d'investissement Amazon au capital), une option sur ~10 % d'AMD via warrants.

Il faut donc distinguer deux lectures. La lecture optimiste : le financement circulaire est normal dans une industrie capitalistique. Les fournisseurs financent parfois leurs clients quand la demande est stratégique, comme dans l'aéronautique, les télécoms ou l'énergie. La lecture pessimiste : le secteur commence à comptabiliser comme demande réelle des engagements qui dépendent eux-mêmes de la capacité à lever du capital futur. Si les revenus finaux ne progressent pas assez vite, la circularité devient une fragilité.

Un signal précieux est venu de Moody's, qui a estimé en 2026 à environ 662 milliards de dollars les engagements futurs de location de data centers non encore activés au bilan des hyperscalers. Ce chiffre n'est pas une dette en soi, mais il indique l'existence d'une couche d'engagements non immédiatement visibles dans les comptes. Les deux lectures peuvent être vraies en même temps : le cycle peut à la fois construire de l'infrastructure utile et accumuler des fragilités contractuelles.

Le régulateur américain commence d'ailleurs à s'y intéresser. La SEC Division of Examinations a publié en novembre 2025 ses priorités d'examen 2026, qui incluent l'IA parmi les zones de risque. Le périmètre est cependant celui des entités supervisées par cette division — conseillers en investissement, sociétés de gestion (RICs, mutual funds, ETFs), broker-dealers, agents de transfert — et porte sur l'exactitude des déclarations liées à l'IA, les algorithmes de recommandation, les contrôles internes, la gouvernance et les risques cyber et de modèle. Cela confirme une montée du risque réglementaire autour de l'« AI washing » dans la gestion d'actifs et le brokerage, mais ne constitue pas un audit généralisé des disclosures IA ou des engagements cloud de toutes les sociétés cotées. Les graphiques de circularité publiés par Bloomberg et le Wall Street Journal à l'automne 2025, montrant les flux croisés NVIDIA → OpenAI → Oracle → CoreWeave → NVIDIA, ont contribué à mettre le sujet sur la table des comités d'audit. Plusieurs analystes établissent un parallèle explicite avec la fin du cycle des télécoms en 2000-2001, lorsque Cisco finançait l'achat de ses propres équipements par ses clients. Le parallèle reste imparfait — les volumes de calcul livrés et facturés sont, eux, bien réels — mais il suffit pour expliquer la prudence accrue des auditeurs et des comités de risque sur les engagements equity-for-compute.

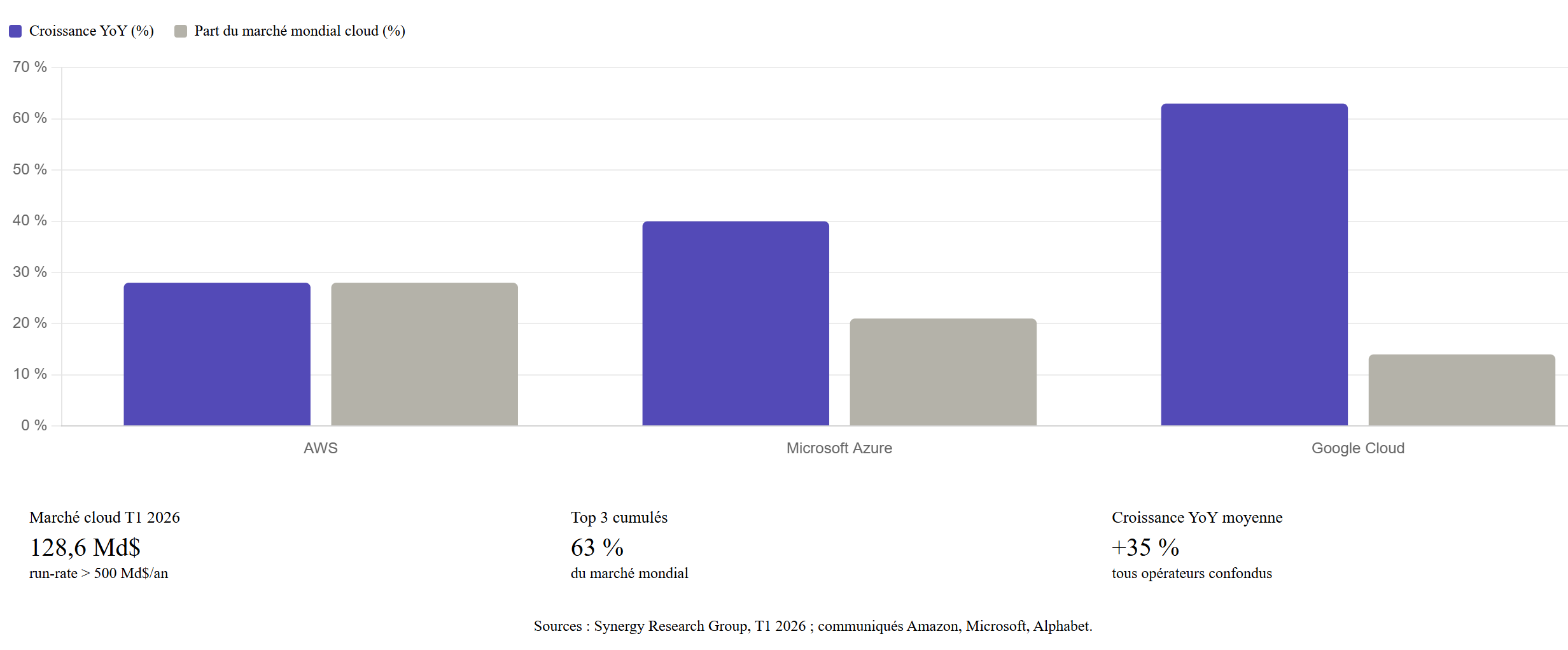

Le marché du cloud : croissance réelle, mais concentration extrême

Le marché mondial du cloud infrastructure continue d'accélérer. Selon Synergy Research Group, les dépenses entreprises en infrastructure cloud ont atteint 128,6 milliards de dollars au T1 2026, avec une croissance de 35 % sur un an. Le run-rate annualisé dépasse 500 milliards de dollars. Les parts de marché mondiales étaient de 28 % pour Amazon, 21 % pour Microsoft et 14 % pour Google.

Cela montre que les revenus ne sont pas imaginaires. La demande existe, la croissance est mesurable, et l'IA augmente l'usage du cloud. Mais la concentration est extrême : trois acteurs captent près des deux tiers du marché, tandis que les nouveaux entrants doivent financer leurs capacités à très grande vitesse pour rester crédibles.

Les neoclouds apparaissent comme une deuxième couche : CoreWeave, Nebius, Crusoe, Lambda, IREN, Cipher. Leur avantage est la spécialisation. Leur faiblesse est la dépendance à quelques clients, à quelques fournisseurs de puces et à des financements adossés à des actifs qui peuvent se déprécier vite. Le contrat moyen pondéré chez CoreWeave est désormais de cinq ans, ce qui réduit le risque, mais ne l'élimine pas.

Du Capex à l'Opex : la nouvelle équation énergétique et la pression sur le coût du token

Pendant la majeure partie du cycle, les marchés se sont concentrés sur le capex. La discussion bascule désormais vers l'opex : ce que coûte, par requête et par mois, le fait de faire fonctionner cette infrastructure. Trois éléments expliquent ce déplacement.

Le premier est l'inflation des composants. Amy Hood, directrice financière de Microsoft, a explicitement attribué 25 milliards de dollars de la hausse 2026 du capex du groupe au seul renchérissement des composants, en particulier la mémoire — un signal que le secteur subit le même type de pression d'inputs que d'autres industries lourdes. TSMC a parallèlement averti que le coût de production unitaire augmente significativement à chaque saut de nœud (N3 → N2 → A14). Meta a explicitement justifié sa hausse de guidance 2026 par les prix des composants.

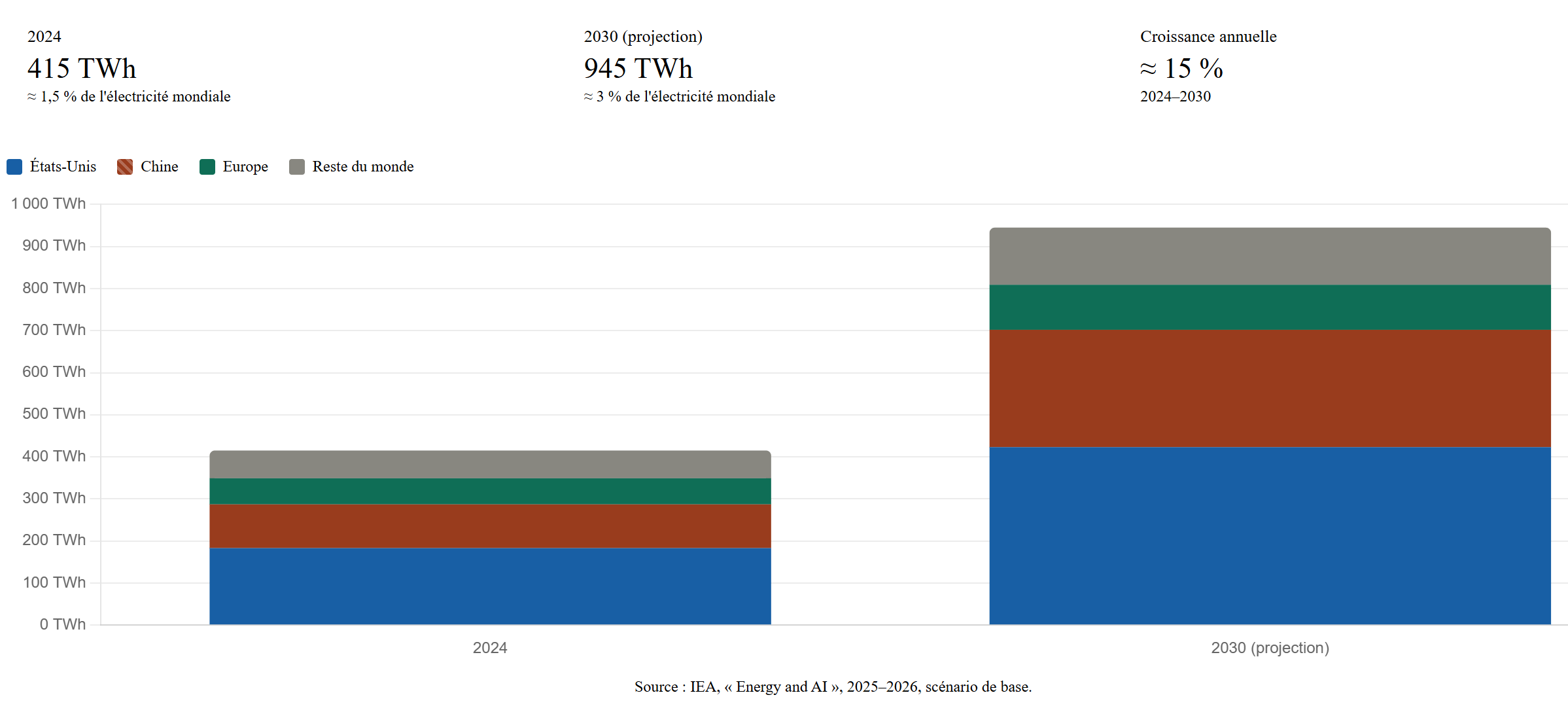

Le deuxième est l'énergie. La question n'est plus de savoir si la facture électrique des data centers va doubler — l'IEA table sur 945 TWh en 2030 contre 415 TWh en 2024 — mais qui paiera et à quel prix. Aux États-Unis, certains États ont commencé à dissocier les tarifs réseau pour les très gros consommateurs IA, des projets négocient des contrats de gré à gré avec des centrales nucléaires (SMR ou centrales existantes), d'autres déploient du gaz behind-the-meter (15-27 GW projetés à 2030) avec des marges de surdimensionnement de 30 à 70 % pour assurer la fiabilité. Le coût marginal du kilowattheure devient une variable de pricing pour les tokens.

Le troisième est la concurrence sur le prix du token. La compression des prix d'API chez les modèles fondamentaux est continue depuis 2023, accélérée par les modèles open weights (Llama, Qwen, DeepSeek) et par les ASIC maison qui réduisent le coût d'inference chez les grandes plateformes. Combiné à la migration partielle vers l'Edge, cela crée un effet ciseaux : le coût total de servir une requête augmente côté infrastructure (énergie, mémoire, refroidissement), tandis que le prix facturé baisse côté client. Les laboratoires les mieux placés sont ceux qui contrôlent à la fois le silicium, le data center et le modèle — autrement dit, les acteurs intégrés. Pour les laboratoires « pure-players », l'équation devient plus serrée : OpenAI ne projette pas de free cash flow positif avant 2029.

C'est ce déplacement du débat — du capex vers l'opex énergétique et le coût marginal du token — qui détermine désormais la pente future des marges, plus encore que la performance brute des modèles.

Le capital-risque : moins de deals, plus de méga-tours

Le financement des startups IA suit la même logique de concentration. Selon Crunchbase, l'IA a capté environ 80 % du financement venture mondial au T1 2026. Quatre entreprises seulement — OpenAI, Anthropic, xAI et Waymo — ont levé ensemble 188 milliards de dollars, soit près de 65 % de tout le capital-risque mondial du trimestre.

Le phénomène ne s'arrête pas aux trois principaux laboratoires de modèles. Sierra, fondé par Bret Taylor, a levé 950 millions de dollars en Série E en mai 2026 à une valorisation de 15,8 milliards, avec un run-rate qui a dépassé 150 millions en huit trimestres. Des acteurs comme Cursor (codage agentique), Replit, Cohere, Perplexity ou Mistral continuent de mobiliser des montants à neuf chiffres. Mais la concentration s'accentue : les méga-tours absorbent une part croissante du gâteau, et les fonds traditionnels sont désormais en concurrence avec les hyperscalers, les fonds souverains, les family offices et les marchés obligataires sur les mêmes dossiers.

Cette concentration augmente le risque macrofinancier. Si un ou deux grands laboratoires manquent leurs objectifs de revenus, l'impact ne serait pas limité à leurs actionnaires : il toucherait les fournisseurs de cloud, les fabricants de puces, les neoclouds, les détenteurs de dette et les marchés publics.

La Chine : moins de GPU, plus de contrainte stratégique

La Chine ne dispose pas du même accès aux puces avancées américaines, mais elle accélère sur ses propres infrastructures. ByteDance aurait préparé un plan de capex de 160 milliards de yuans, soit environ 22,7 milliards de dollars, pour l'infrastructure IA en 2026, selon le Financial Times. Reuters précise que cette information n'a pas pu être vérifiée indépendamment. Alibaba et Tencent ont également relevé leurs capex pour soutenir la course intérieure à l'IA générative.

Le cas chinois illustre un autre modèle : moins d'accès aux meilleurs GPU, mais une pression politique forte pour développer des alternatives nationales. Huawei, avec sa gamme Ascend, devient central. Des acteurs comme DeepSeek, MiniMax, Moonshot AI, Baichuan ou Zhipu sont insérés dans une stratégie d'autonomie technologique.

La contrainte américaine sur les exportations de puces a un effet paradoxal : elle ralentit l'accès chinois au calcul de frontière, mais elle accélère la construction d'une chaîne domestique concurrente. À horizon 2030, l'IEA estime que la consommation électrique des data centers chinois augmentera de 175 TWh, soit +170 % par rapport à 2024.

Le mur énergétique

L'énergie est le facteur limitant le plus concret. Selon l'IEA, les data centers représentaient environ 415 TWh de consommation électrique mondiale en 2024, soit 1,5 % de l'électricité mondiale. Les États-Unis représentaient 45 % de cette consommation, la Chine 25 % et l'Europe 15 %. Sur les cinq dernières années, la croissance a atteint 12 % par an.

L'IEA projette un doublement à 945 TWh en 2030 dans son scénario de base, soit près de 3 % de la demande mondiale d'électricité. Les serveurs accélérés, principalement liés à l'IA, devraient voir leur consommation croître d'environ 30 % par an. Les États-Unis et la Chine concentrent près de 80 % de la croissance projetée : +240 TWh aux États-Unis (+130 % vs 2024), +175 TWh en Chine (+170 %), +45 TWh en Europe (+70 %), +15 TWh au Japon (+80 %).

Aux États-Unis, les data centers ont consommé environ 183 TWh en 2024, soit plus de 4 % de l'électricité nationale, et pourraient atteindre 426 TWh en 2030. Le Department of Energy américain, citant l'EPRI, indique que les data centers pourraient représenter jusqu'à 9 % de la production électrique américaine annuelle en 2030. La mise à jour EPRI publiée le 26 février 2026 (« Powering Intelligence 2026 ») élargit cette fourchette à 9 à 17 % de l'électricité américaine en 2030 selon les scénarios de croissance — soit une révision à la hausse d'environ 60 % par rapport à l'estimation EPRI 2024 — et identifie huit États (Arizona, Indiana, Iowa, Nebraska, Nevada, Oregon, Wyoming, Virginie) où les data centers pourraient dépasser 20 % de la consommation locale.

Le mix énergétique est lui aussi en mutation. En 2024, les data centers étaient alimentés à 30 % par le charbon (principalement en Chine), 27 % par les renouvelables, 26 % par le gaz naturel et 15 % par le nucléaire. L'IEA projette que les renouvelables passeront à environ 50 % du mix d'ici 2030, le gaz et le nucléaire conservant chacun un rôle structurant. Environ 15 à 27 GW de capacité de gaz behind-the-meter pourraient être installés sur sites aux États-Unis d'ici 2030, et 20 à 25 GW de capacité de stockage par batteries.

Les émissions associées sont également en hausse, mais leur trajectoire dépend fortement du scénario retenu. L'IEA estime à environ 180 millions de tonnes de CO₂ les émissions actuelles liées à l'électricité consommée par les data centers, et projette dans son scénario de base un pic vers 2030 puis un léger recul pour atteindre environ 300 Mt en 2035 ; dans le scénario Lift-Off (déploiement IA accéléré), elles peuvent atteindre près de 500 Mt en 2035, tandis que les scénarios High Efficiency et Headwinds restent en dessous du Base Case. La part des fossiles dans le mix électrique des data centers reste autour de 40 % en 2035 dans tous les cas, et c'est principalement la décarbonation parallèle de la production électrique qui explique le tassement des émissions, malgré une consommation en forte hausse.

La conséquence politique est immédiate : qui paie les réseaux, les centrales, les lignes de transmission et les réserves de capacité ? Les ménages ? Les industriels ? Les hyperscalers ? Les États ? L'IA devient ici un sujet de tarification électrique et de justice territoriale. L'IEA avertit qu'en l'absence d'investissements massifs dans les réseaux, jusqu'à 20 % des projets de data centers annoncés pourraient subir des retards.

Cette équation se joue désormais aussi du côté des utilities régulées et des opérateurs de data centers. American Electric Power (AEP) a relevé le 5 mai 2026 son plan d'investissement à cinq ans de 72 à 78 milliards de dollars, après avoir ajouté 7 GW de charge contractée au premier trimestre, pour un total de 63 GW de charges sécurisées par contrat ; environ 90 % de cette demande vient des data centers, dont 53 GW concentrés en Texas et en Ohio. La société projette un CAGR de la base tarifaire de 11 % par an et une croissance des résultats opérationnels long terme supérieure à 9 %, contre une fourchette précédente de 7-9 %. Le management estime à 16 milliards les cost offsets associés aux contrats grands comptes, censés limiter l'impact tarifaire pour les clients résidentiels. Le lendemain, 6 mai 2026, Hut 8 a commercialisé la première phase de son campus Beacon Point (Nueces County, Texas) via un bail triple net de quinze ans à 9,8 milliards de dollars de loyers de base — pouvant aller jusqu'à 25,1 milliards si toutes les options de renouvellement sont exercées — pour 352 MW d'une capacité interconnectée de 1 GW. Le locataire, qualifié de « high investment grade » mais non nommé, déploiera une architecture conforme au standard NVIDIA DSX, avec une mise sous tension prévue au T1 2027 et une première livraison de salle au T3 2027. Le portefeuille total contracté de Hut 8 passe ainsi à 597 MW pour 16,8 milliards de loyers de base et un NOI annuel cible d'environ 1,1 milliard, exécuté avec AEP, Vertiv et Jacobs comme partenaires de premier rang. Ces deux annonces illustrent un même fait : la facture énergétique de l'IA n'est plus un sujet à venir, c'est un flux contractuel signé.

Le pivot obligataire : quand Big Tech finance l'IA à crédit

Un fait marquant des derniers mois est le retour massif de Big Tech sur les marchés de la dette. La logique a changé. Pendant deux décennies, Apple, Microsoft, Alphabet, Meta et Amazon finançaient leurs investissements presque entièrement sur leurs propres cash flows. En 2026, le capex IA dépasse la capacité de génération de trésorerie disponible, et les marchés obligataires deviennent un complément structurel de financement.

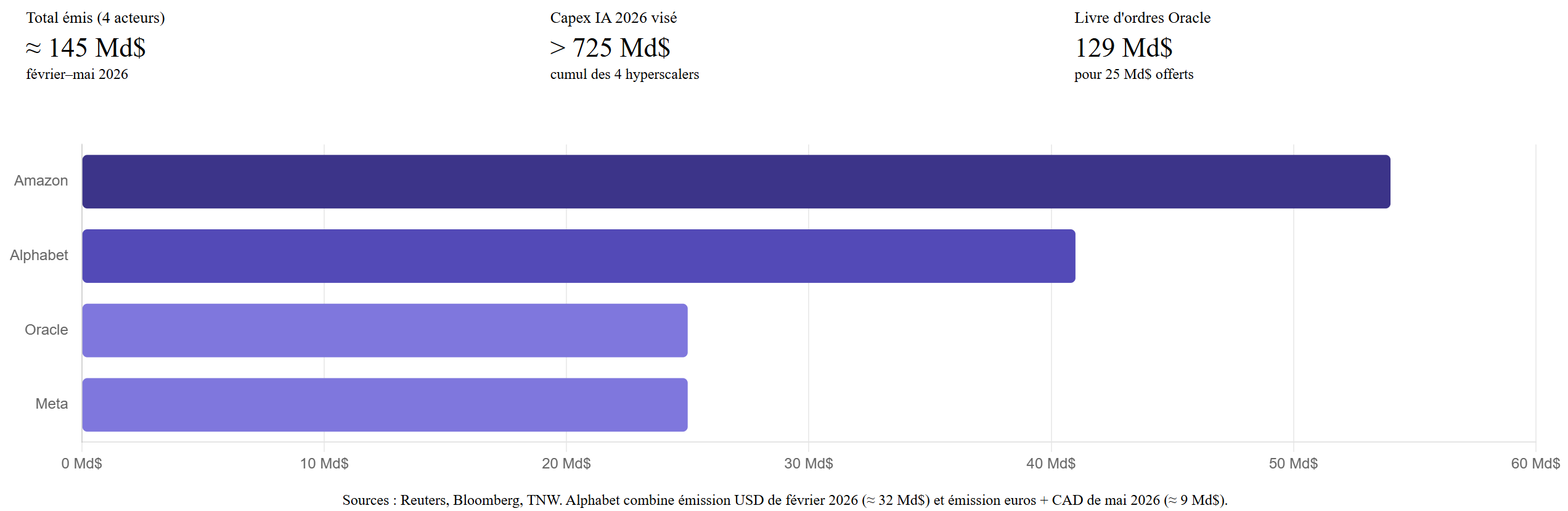

Amazon a levé près de 54 milliards de dollars en mars 2026. Alphabet a placé environ 32 milliards en février — en dollars, livres et francs suisses — incluant une obligation sterling à 100 ans, une première dans la tech depuis Motorola en 1997, puis a complété cette opération par une émission euros en six tranches d'au moins 3 milliards le 5 mai 2026 (plus un volet en dollars canadiens en quatre tranches), avec une demande supérieure à 25 milliards d'euros pour environ 9 milliards offerts, à une notation S&P AA+. Oracle a levé 25 milliards de dollars dans une émission qui a attiré un livre d'ordres record de 129 milliards. Le 30 avril 2026, Meta a placé 25 milliards de dollars d'obligations en six tranches — incluant une note à échéance 2066 — avec un livre d'ordres au pic d'environ 96 milliards, en repli toutefois par rapport aux 125 milliards demandés sur sa précédente émission record de 30 milliards d'octobre 2025. Plusieurs tranches ont été émises à un spread plus large que l'émission précédente, et les CDS Meta ont touché des plus hauts historiques, signe que le marché commence à intégrer une prime de risque à mesure que les engagements capex montent. Les quatre principaux hyperscalers américains devraient consacrer collectivement plus de 725 milliards de dollars au capex IA en 2026, soit l'équivalent de plus de 90 % de leur cash flow opérationnel attendu sur l'année selon Goldman Sachs

Cette montée du levier ne signifie pas que Big Tech est en difficulté financière — les notations restent investment grade et la liquidité est massive — mais elle déplace le risque. Les détenteurs d'obligations Big Tech parient désormais aussi sur la monétisation de l'IA. Le pricing du risque, lui, commence visiblement à se durcir.

Le vrai risque : cinq vulnérabilités qui ne sont pas la même chose

Parler de « bulle IA » est insuffisant et imprécis. Le cycle actuel ne ressemble pas à une pure bulle spéculative, parce que les revenus existent : AWS croît de 28 % sur un an, Google Cloud de 63 %, Azure de 40 %, ChatGPT compte plus de 900 millions d'utilisateurs hebdomadaires, NVIDIA publie 215,9 milliards de dollars de revenus annuels et 75 % de marge brute, Broadcom double ses revenus IA. Mais le cycle agrège plusieurs risques de natures différentes, qu'il vaut mieux distinguer.

Premier risque, la bulle de valorisation sur les actifs cotés liés à l'IA. Les multiples des hyperscalers, des fabricants de puces et des neoclouds intègrent une trajectoire de croissance qui peut se retourner si la monétisation déçoit, sans que l'infrastructure construite soit pour autant inutile.

Deuxième risque, le surinvestissement d'infrastructure. Si les hyperscalers collectivement construisent plus de capacité qu'il n'y a de demande solvable, on entre dans un cycle de surcapacité comparable à celui des télécoms en 2000-2001, avec une pression durable sur les prix du calcul et une dépréciation accélérée des actifs.

Troisième risque, le cycle de dette. Le pivot obligataire évoqué plus haut est rationnel à court terme, mais il transforme un secteur historiquement à cash flow libre élevé en secteur à dette structurellement plus lourde. Le risque n'est pas la solvabilité de Big Tech à court terme, mais la sensibilité de l'ensemble — hyperscalers, neoclouds, fournisseurs de capacité, private credit finançant les data centers — à une remontée des spreads ou à un cycle de taux moins favorable.

Quatrième risque, le mauvais appariement temporel entre capex et revenus. C'est probablement le plus concret. Les entreprises construisent aujourd'hui une infrastructure qui doit être amortie sur sept à dix ans, alors que les usages, les prix par token, les modèles, les architectures et la concurrence évoluent à l'échelle de quelques mois. Les annonces de custom silicon chez Google, Meta, Amazon, Microsoft, OpenAI et Anthropic réduisent la rente future des fabricants généralistes au moment même où NVIDIA tente de capturer cette rente. La révision par OpenAI de ses engagements infrastructure de 1 400 à 600 milliards de dollars d'ici 2030, en moins de trois mois, montre que ce risque est désormais pris au sérieux par les laboratoires eux-mêmes.

Cinquième risque, la circularité contractuelle. Le rapprochement croissant entre fournisseurs et clients — NVIDIA au capital d'OpenAI et de CoreWeave, Amazon actionnaire d'Anthropic qui s'engage en retour sur AWS, Alphabet portant son investissement dans Anthropic à plus de 40 milliards en parallèle d'un contrat Google Cloud de 200 milliards — soulève une question simple : quelle part du backlog cloud et des engagements de calcul reflète une demande finale véritable, et quelle part reflète des flux croisés entre actionnaires et clients communs ? Les graphiques de circularité publiés par Bloomberg et le WSJ, et l'attention croissante de la SEC aux déclarations et contrôles liés à l'IA dans ses priorités d'examen 2026 — même si la circularité contractuelle relève surtout à ce stade de l'analyse financière et de la presse économique — montrent que cette question n'est plus théorique.

Trois trajectoires synthétiques ressortent de ces cinq risques. La demande absorbe l'offre : les agents, le code, la vidéo, la robotique et l'industrie consomment tellement de calcul que l'infrastructure paraît insuffisante dès 2028-2030 — le franchissement par Anthropic de 30 milliards de dollars de run-rate en moins de trois ans plaide en ce sens. La productivité arrive, mais la rente migre : les modèles deviennent moins différenciés, le prix par token baisse, la valeur se déplace vers les intégrateurs, les plateformes cloud, les propriétaires de données et les fabricants de silicium. Le cycle est surdimensionné : la correction toucherait d'abord les neoclouds, puis les fournisseurs de capacité, puis les valorisations des laboratoires, avant d'atteindre les fabricants de puces.

Conclusion : la vraie guerre de l'IA n'est pas seulement le modèle, c'est le calcul

L'économie de l'IA entre dans une phase où la performance des modèles reste importante, mais ne suffit plus. Le facteur décisif devient l'accès au calcul fiable, bon marché, alimenté, refroidi, financé et sécurisé.

NVIDIA vend le cœur de la machine. TSMC fabrique les composants les plus critiques. Broadcom aide les plateformes à internaliser une partie du silicium. Amazon, Microsoft, Alphabet, Meta et Oracle construisent les couches de cloud et de data centers. OpenAI, Anthropic et xAI transforment cette infrastructure en produits. Les fonds souverains (GIC, Qatar Investment Authority, MGX, Temasek), les marchés obligataires et les États fournissent le capital. Les réseaux électriques absorbent le choc.

C'est pourquoi l'IA générative n'est plus seulement une révolution logicielle. C'est une réindustrialisation du numérique. Et comme toute réindustrialisation, elle produit des gagnants, des goulets d'étranglement, des surcapacités possibles, des conflits politiques et des effets macroéconomiques.

Le point le plus important est peut-être celui-ci : même si une partie du capital est mal allouée, l'infrastructure construite ne disparaîtra pas. Comme la fibre optique après 2001, elle pourra devenir la base d'usages futurs. Mais cela ne signifie pas que tous les investisseurs actuels gagneront de l'argent. Une infrastructure peut être utile à la société tout en détruisant le capital de ceux qui l'ont financée trop cher.